Прочие материалы с lesswrong.com

Сюда попадают все материалы, которые не входят в книгу «Рациональность: от ИИ до Зомби». Также здесь могут встречаться материалы, которые в упомянутую книгу входят, но как часть «Цепочек», которые почти не переведены на русский.

Особо продвинутая эпистемология для начинающих

Подробное руководство по эпистемологии от Элиезера Юдковского. Включает практические приложения и задачи для читателя.

Полезная идея истины

Помню, как я однажды сдавала письменную работу по экзистенциализму. Преподаватель вернула мне её с оценкой «плохо». Она подчеркнула слова «истина» и «истинный» везде, где они встречались в эссе, примерно двадцать раз, и рядом с каждым поставила вопросительный знак. Она хотела узнать, что я понимаю под истиной.

— Даниэлла Эган

Я понимаю, что значит называть гипотезу элегантной, или фальсифицируемой, или соответствующей экспериментальным данным. Мне кажется, что называть убеждение «истинным», или «настоящим», или «действительным» — это всего лишь делать различие между утверждением, что вы во что-то верите, и утверждением, что вы во что-то очень-очень сильно верите.

— Дейл Каррико

Итак, что такое истина? Движущаяся толпа метафор, метонимий, антропоморфизмов, — короче, сумма человеческих отношений, которые были возвышены, перенесены и украшены поэзией и риторикой и после долгого употребления кажутся людям каноническими и обязательными.

— Фридрих Ницше

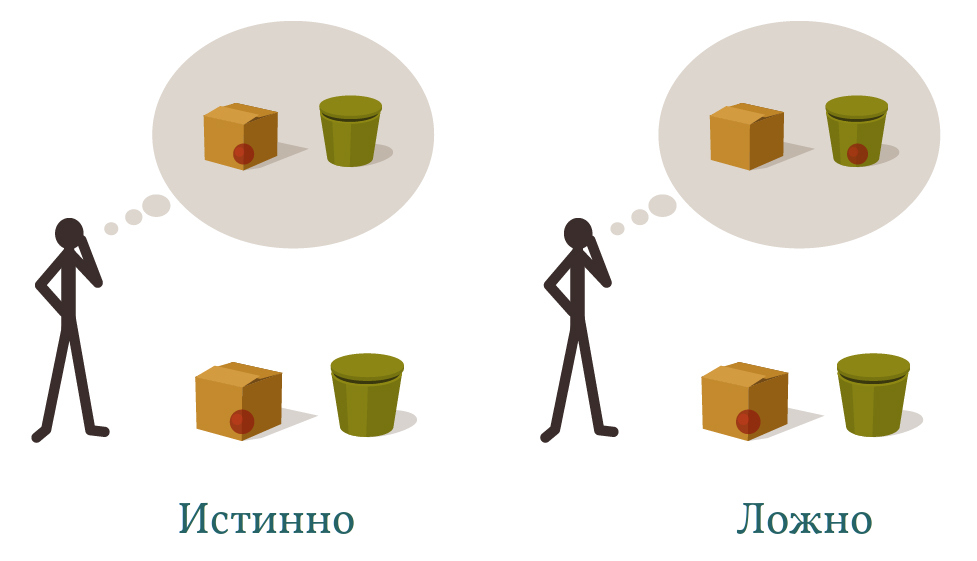

Задача на ложные убеждения «Салли–Анна» — это эксперимент, который используется, чтобы установить, понимает ли ребёнок разницу между убеждением и реальностью. Проводится он так:

- Ребёнок видит, как Салли прячет шарик в закрытую корзину, а Анна за этим наблюдает.

- Салли выходит из комнаты, а Анна вынимает шарик из корзины и прячет его в закрытую коробку.

- Анна выходит из комнаты, и Салли возвращается.

- Экспериментатор спрашивает ребёнка, где Салли будет искать шарик.

Дети до четырёх лет говорят, что Салли будет искать шарик в коробке, а более старшие дети — что в корзине.

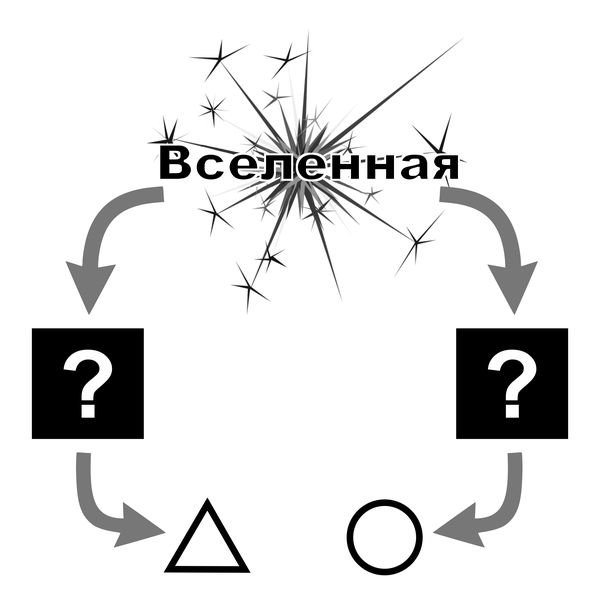

Человеческие дети, начиная с возраста (обычно) в четыре года, впервые начинают понимать, что это значит, когда убеждения утрачивают связь с реальностью. Трёхлетний ребёнок моделирует только то, где находится шарик. Четырёхлетний ребёнок, начиная вырабатывать теорию сознания, отдельно моделирует, где находится шарик, и отдельно — где находится шарик по убеждению Салли, и может заметить, когда эти понятия конфликтуют — когда у Салли есть ложное убеждение.

Любое осмысленное убеждение имеет условие истинности, то есть реальность может каким-то образом быть такой, чтобы это убеждение было истинным или наоборот, ложным. Если мозг Салли содержит мысленный образ шарика в корзине, то в реальности шарик действительно может лежать в корзине — и в этом случае убеждение Салли называется «истинным», поскольку реальность удовлетворяет его условию истинности. Либо же возможно, что Анна вынула шарик и спрятала его в коробке, и в этом случае убеждение Салли называется «ложным», поскольку реальность не удовлетворяет его условию истинности.

Математик Альфред Тарский однажды описал понятие «истины» как бесконечную серию условий истинности:

- Предложение «снег белый» истинно тогда и только тогда, когда снег белый.

- Предложение «небо голубое» истинно тогда и только тогда, когда небо голубое.

Теперь кажется, что различие тут тривиально: зачем вообще говорить о предложениях, если предложение выглядит настолько похожим на реальность, когда и предложение, и реальность описаны на одном и том же языке?

Но когда мы оглядываемся на задачу «Салли–Анна», это различие становится куда яснее: убеждение Салли закодировано конфигурацией нейронов и нейронных путей в мозгу Салли, во влажной и чрезвычайно сложной органической ткани массой в килограмм с третью, находящейся внутри черепа Салли. Сам же шарик — это маленькая пластиковая сфера, которая перемещается между корзиной и коробкой. Сравнивать убеждение Салли с шариком — значит сравнивать совершенно разные вещи.

Тогда зачем вообще говорить об абстрактных «предложениях», а не об убеждениях, закодированных нейронами? Может быть так, что Салли и Фред верят «в одно и то же», то есть их мозги содержат внутренние модели шарика в корзине — то есть оба утверждения, каждое в своём мозге, имеют одинаковое условие истинности. В этом случае можно абстрагировать то, что эти убеждения имеют между собой общего, то есть общее условие истинности, в виде предложения или утверждения, которое мы считаем истинным или ложным отдельно от каких-либо верящих в него мозгов.

Некоторые мыслители выражают панику по поводу того, что любое суждение об истине — любое сравнение убеждения с реальностью — является частью чьего-то мышления, и, казалось бы, всего лишь сравнивает чужое убеждение со своим собственным:

То есть получается, что все эти разговоры об истине — это всего лишь сравнение чужих убеждений со своими и попытка установить свой авторитет? Получается, что слово «истина» — всего лишь оружие в борьбе за власть?

Мало того, мы даже не можем напрямую сравнить чужие убеждения с своими собственными. Мы можем только сравнить, внутри себя, наше убеждение о чьём-то чужом убеждении с нашим собственным убеждением — сравнить нашу карту их карты с нашей картой территории.

Аналогично получается, что когда мы говорим о наших собственных убеждениях, что они «истинны», это означает, что мы сравниваем свою карту своей карты со своей картой территории. Обычно люди не ошибаются в своём представлении о том, во что они верят. Хотя из этого правила есть определённые исключения, обычно карта карты верна, то есть люди обычно имеют верные убеждения о том, какие убеждения они имеют:

Следовательно, сказать «Я считаю, что небо голубое, и это верно!» — обычно значит выразить ту же информацию, которую выражают предложения «Я считаю, что небо голубое» или просто «Небо голубое», то есть информацию о том, что ваша мысленная модель мира содержит голубое небо.

Подумайте над вопросом:

Если это так, то получается, что постмодернисты правы? Получается, что все эти рассуждения об «истине» — это всего лишь попытка установить приоритет ваших собственных убеждений над чужими, и нет способа сравнить убеждение с самой реальностью, а не с содержимым чьей-то головы?

Здесь и далее я буду вставлять вопросы, над которыми читателям предлагается найти ответ самостоятельно, прежде чем двигаться дальше. Это моя несколько неуклюжая попытка отразить результаты исследований, показавших, что читатели значительно чаще запоминают какой-то факт или решение проблемы, если сначала пытаются решить проблему сами, прежде чем прочитать решение. Удастся вам решить проблему или нет, главное — попытаться и только затем читать дальше. Здесь отражена также проблема, существующая по мнению Майкла Вассара: поскольку статьи такого рода часто кажутся очевидными после прочтения, читателям зачастую сложно визуализировать разницу между «до» и «после», и для целей обучения эту разницу полезно себе представлять. Поэтому, пожалуйста, попытайтесь сначала высказать свой собственный ответ на вопрос — в идеале прошепчите его себе, либо двигайте губами, представляя, как вы его проговариваете, чтобы сделать его явным и доступным для вашей памяти — прежде чем продолжать. Попытайтесь также осознанно заметить разницу между вашим ответом и ответом, приведённым в статье, включая любые дополнительные или отсутствующие детали, и не пытайтесь увеличить или уменьшить это различие.

…

…

…

Ответ:

Ответ, который я дал Дейлу Каррико — который заявил мне, что знает, что означает фальсифицируемость убеждения, но не знает, что означает его истинность, — состоял в том, что мои убеждения определяют мои экспериментальные предсказания, но только реальность может определять мои экспериментальные результаты. Если я очень сильно верю в то, что я умею летать, то это убеждение может сподвигнуть меня сделать шаг с обрыва, ожидая, что он безопасен; но только истинность этого убеждения может спасти меня от смертельного падения.

Поскольку мои ожидания иногда конфликтуют с тем, что я затем вижу и ощущаю происходящим вокруг меня, мне нужны разные названия для того, что определяет мои экспериментальные предсказания, и для того, что определяет мои экспериментальные результаты. Первое я называю «убеждениями», а второе — «реальностью».

Вы не получите прямого столкновения между убеждениями и реальностью — или между чужими убеждениями и реальностью — если будете сидеть в комнате с закрытыми глазами. Но если вы откроете глаза, ситуация изменится!

Давайте проследим за тем, как ваш мозг получает информацию о том, что ваши шнурки развязаны:

- Фотон покидает Солнце и летит к Земле через её атмосферу.

- Ваш шнурок поглощает и снова испускает этот фотон.

- Отражённый фотон проходит через зрачок вашего глаза и направляется на сетчатку.

- Фотон падает на клетку-палочку или клетку-колбочку, или, ещё точнее, он падает на фоторецептор, форму витамина А, известную как ретиналь. Эта молекула затем изменяет свою форму, вращаясь вокруг двойной связи, благодаря поглощению энергии фотона. Связанный белок под названием опсин в ответ претерпевает смену конформации, и это возмущение далее распространяется на тело нервной клетки, которая наполняет энергией протон и увеличивает его поляризацию.

- Постепенное изменение поляризации распространяется на биполярную клетку и затем клетку ганглия. Если поляризация клетки ганглия превышает определённую границу, клетка испускает нервный импульс — распространяющееся электрохимическое явление поляризации-деполяризации, которое проходит по мозгу со скоростью от 1 до 100 метров в секунду. Таким образом, свет из внешнего мира преобразуется в информацию внутри нервной системы, совместимую с субстратом остальных мыслей.

- Нервный сигнал подвергается предварительной обработке другими нейронами в сетчатке, затем в латеральном коленчатом теле в середине мозга, после чего в зрительной коре, находящейся в задней части головы, восстанавливается уменьшенное изображение окружающего мира — изображение, закодированное в частотах испускания сигналов нейронами, составляющими зрительную кору. (Это изображение искажено, поскольку центр поля зрения обрабатывается со значительно большей степенью детализации, чем его края, — то есть распределяется между большим числом нейронов и большей площадью коры.)

- Информация из зрительной коры затем направляется в височные доли, которые отвечают за распознавание объектов.

- Ваш мозг распознаёт форму развязанного шнурка.

Так ваш мозг обновляет свою картину мира, включая в неё тот факт, что ваши шнурки развязаны. Даже если до этого он ожидал увидеть их связанными! У вашего мозга нет никакой причины не обновлять свою картину мира, если только в этом не замешана политика. Когда фотоны, направляющиеся в сторону глаза, преобразуются в нервные сигналы, они принимают форму, совместимую с другой содержащейся в мозгу информацией, и могут сравниваться с предыдущими убеждениями.

Убеждения и реальность взаимодействуют постоянно. Если бы мозг и его окружение никогда не соприкасались, нам не нужны были бы ни глаза, ни руки, и мозг мог бы иметь намного более простое строение. Организмам вообще не нужны были бы мозги.

Хорошо, убеждения и реальность — это разные сущности, которые пересекаются и взаимодействуют. Но из того, что нам нужны отдельные понятия для «убеждений» и «реальности», ещё не следует потребность в понятии «истины», то есть сравнения между ними. Возможно, мы могли бы говорить отдельно (а) о представлениях некоего разумного существа о том, что небо голубое, и (б) о самом небе. Вместо того, чтобы говорить «Джейн считает, что небо голубое, и она права», мы могли бы сказать «Джейн считает, что небо голубое; кроме того, небо голубое» и тем самым выразить ту же информацию (а) о наших убеждениях относительно неба и (б) о наших убеждениях относительно убеждений Джейн. Мы всегда могли бы, применяя схему Тарского «Предложение “X“ истинно тогда и только тогда, когда X», заменить любое утверждение об истинном предложении утверждением о его условии истинности, о соответствующем состоянии реальности (неба или чего-нибудь ещё). Так мы могли бы вообще избежать этого надоедливого слова «истина», о котором философы ведут бесконечные споры и которым злоупотребляют разные раздражающие личности.

Пусть есть некое разумное существо — для определённости пусть это будет искусственный интеллект, который занимается своей работой в одиночку и которому никогда не требовалось ни с кем спорить о политике. ИИ знает, что «Моя модель полагает с вероятностью 90%, что небо голубое»; он уверен в том, что эта вероятность — это именно то предложение, которое сохранено в его оперативной памяти. Отдельно ИИ моделирует, что «Вероятность того, что мои оптические датчики обнаружат за окном голубой цвет, равна 99% при условии, что небо голубое», и не путает это утверждение с утверждением о том, что его оптические датчики обнаружат голубой цвет, когда он полагает, что небо голубое. Значит, этот ИИ определённо может отличать карту от территории; он знает, что разные состояния его оперативной памяти имеют последствия и причинно-следственные связи, отличные от тех, какими обладают разные состояния неба.

Но может ли этому ИИ понадобиться общее понятие истины — может ли ему понадобиться придумать слово «истина»? Почему, если бы у него было это понятие, он мог бы работать лучше?

Подумайте над вопросом: Если мы имеем дело с искусственным интеллектом, которому не нужно ни с кем спорить о политике, может ли ему когда-нибудь понадобиться слово или понятие «истина»?

…

…

…

Ответ: Абстрактное понятие «истины» — общая идея о соответствии карты и территории — нужно, чтобы выразить такие идеи, как:

- Обобщение по всем возможным картам и городам: если ваша карта города точна, то более вероятно, что навигация по этой карте вовремя доставит вас в аэропорт.

- Чтобы начертить верную карту города, кто-то должен выйти на улицу и посмотреть на здания. Вы не сможете составить точную карту, сидя в комнате с закрытыми глазами и пытаясь представить, каким бы вы хотели видеть город.

- Истинные убеждения с большей вероятностью делают правильные экспериментальные предсказания, чем ложные убеждения; поэтому, если мы будем больше доверять гипотезам, делающим правильные экспериментальные предсказания, наша модель реальности со временем будет становиться всё более верной.

В этом и состоит главное преимущество рассуждений и размышлений об «истине»: мы можем обобщать правила составления карт, соответствующих территориям, и извлекать уроки, которые можно распространять на другие области, а не только на цвет того или иного неба.

Как и всегда, тотальная философская паника оказалась в данном случае необоснованной. Но наша внутренняя оценка «истины» как сравнения между картой карты и картой реальности есть ключевая практическая проблема: в этой схеме мозгу очень просто принять за истину абсолютно бессмысленное предложение.

Пусть некий профессор литературы рассказывает на лекции, что знаменитые писатели Кэрол, Дэнни и Элейн являются «пост-утопистами», что следует из того, что их произведения имеют признаки «колониального отчуждения». Для большинства студентов типичным результатом будет то, что в аналоги ассоциативных массивов в их мозгах к объектам «Кэрол», «Дэнни» и «Элейн» будет добавлено свойство «пост-утопист». Когда в последующей контрольной работе встретится вопрос «Приведите пример писателя — пост-утописта», студент напишет «Элейн». Что, если студент напишет «Я думаю, что Элейн — не пост-утопист»? Тогда профессор смоделирует…

…и пометит ответ как неправильный.

В конце концов…

- Предложение «Элейн — пост-утопист» истинно тогда и только тогда, когда Элейн — пост-утопист.

…правильно?

Может, конечно, быть и так, что этот термин действительно что-то означает (хотя я сам его выдумал). Может даже быть и так, что, хотя профессор не может дать хорошего и явного ответа на вопрос «А что вообще такое пост-утопизм?», тем не менее можно показать многим разным профессорам литературы новые произведения неизвестных им авторов, и все они независимо придут к одному и тому же ответу, из чего последует, что какое-то доступное чувствам свойство текста они явно обнаруживают. Мы не всегда знаем, как работают наши мозги, и мы не всегда знаем, что мы видим, и небо было голубым задолго до того, как появилось слово «голубой»; чтобы часть картины мира в вашем мозгу имела смысл, не требуется, чтобы вы могли объяснить её словами.

С другой стороны, может быть и так, что профессор узнал о «колониальном отчуждении», зазубрив то, что ему в своё время говорил его профессор. Может быть так, что единственный человек, чей мозг когда-то вкладывал в эту фразу реальный смысл, уже умер. Так что к тому времени, как студенты узнают, что слово «пост-утопист» — это пароль, который требуется называть в ответ на запрос «колониальное отчуждение», обе фразы стали не более чем словесными ответами. которые требуется заучивать, не более чем набором ответов для теста.

Эти две фразы не выглядят «оторванными» от реальности сами по себе, потому что они не оторваны друг от друга: пост-утопизм как будто имеет последствие в виде колониального отчуждения, а если вы спросите, что следует из колониального отчуждения, то это означает, что автор, скорее всего, пост-утопист. Но если вы очертите кругом эти два понятия, то обнаружите, что ни с чем больше они не связаны. Это плавающие убеждения, никак не связанные со всей остальной моделью. И тем не менее нет никакого внутреннего тревожного сигнала, который бы звучал, когда такое происходит. Точно так же, как «неправота ощущается как правота» — так же, как обладание ложным убеждением ощущается как обладание истинным убеждением, по крайней мере до проведения эксперимента, — так и бессмысленное убеждение может ощущаться как осмысленное.

Группы, обладающие совершенно бессмысленными убеждениями, могут даже враждовать. Если кто-то спросит «Является ли Элейн пост-утопистом?» и одна группа закричит «Да!», а вторая — «Нет!», они могут подраться просто из-за разных кричалок: для начала вражды необязательно, чтобы слова что-то значили. С тем же успехом может начаться драка между группой, кричащей «Ку!», и группой, кричащей «Кю!» Говоря более общо, важно различать видимые последствия высказанного убеждения, содержащегося в мозгу профессора (студенты должны написать на контрольной то, что нужно, иначе профессор посчитает их ответ неверным) и видимые последствия состояния реальности, не оформленного словесно (то есть состояния территории, при котором Элейн действительно является пост-утопистом).

Одним классическим ответом на эту проблему был верификационизм, который считал, что предложение «Элейн — пост-утопист» является бессмысленным, если оно не говорит нам, какие сенсорные ощущения мы ожидаем испытать, если это предложение истинно, и как эти ощущения будут отличаться в случае, когда предложение ложно.

Но теперь представьте, что я направляю фотон в пустоту между галактиками, и он улетает далеко в глубины космоса. В расширяющейся Вселенной этот фотон в конце концов пересечёт космологический горизонт, за которым, даже если фотон упадёт на зеркало, которое отразит его обратно в направлении Земли, он никогда не вернётся сюда, потому что за это время Вселенная расширится слишком быстро. Следовательно, после того, как фотон пересечёт определённую черту, у утверждения «Фотон продолжает существовать вместо того, чтобы исчезнуть» не будет совершенно никаких экспериментальных последствий.

И тем не менее мне кажется — и, надеюсь, вам тоже, — что утверждение «Фотон внезапно исчезает из мироздания сразу же, как только у нас пропадает возможность его когда-либо увидеть, и тем самым нарушает закон сохранения энергии и ведёт себя не так, как все видимые нам фотоны» ложно, а утверждение «Фотон продолжает существовать, улетая в никуда» истинно. И подобные вопросы могут иметь важные последствия в контексте принятия решений: представьте, что мы думаем о снаряжении околосветового корабля, летящего как можно дальше, так что он пересечёт космологический горизонт до того, как он замедлится, чтобы колонизировать какое-нибудь далёкое сверхскопление галактик. Если бы мы думали, что корабль исчезнет из Вселенной, как только пересечёт космологический горизонт, мы бы не стали и рассматривать возможность отправить его в полёт.

Спрашивать себя об ощутимых последствиях наших убеждений полезно и мудро, но они не подходят на роль фундаментального определения осмысленных утверждений. Это отличная подсказка, сигнализирующая о том, что что-то может быть оторванным от реальности «плавающим убеждением», но не абсолютное правило.

Можно попробовать ответить, что для того, чтобы утверждение было осмысленным, реальность должна иметь возможность быть такой, чтобы это утверждение могло быть истинным или ложным; а поскольку Вселенная состоит из атомов, должна существовать такая конфигурация атомов Вселенной, чтобы это утверждение было истинным или ложным. Например, чтобы утверждение «Я в Париже» было истинным, нужно переместить в Париж составляющие меня атомы. Литературный критик может заявлять, что Элейн имеет свойство, называемое пост-утопизмом, но нет никакого способа перевести это заявление в способ перераспределить атомы Вселенной так, чтобы сделать его истинным или же ложным; следовательно, у него нет условия истинности, то есть оно бессмысленно.

И действительно, существуют такие заявления, при которых, если вы остановитесь и подумаете: «Как можно перестроить Вселенную так, чтобы это было истинным или ложным?», то вы внезапно осознаете, что вы не так хорошо понимаете условие истинности этого заявления, как вы думали. Например, «Страдание закаляет дух» или «Все экономические кризисы — результат плохой денежной политики». Эти утверждения необязательно бессмысленны, но их гораздо проще высказать, чем представить себе мир, в котором они истинны или ложны. Точно так же, как и вопрос об ощутимых последствиях, вопрос о способе конфигурации Вселенной является важным индикатором осмысленности или бессмысленности.

Но если бы вы сказали, что для осмысленности утверждения должна существовать конфигурация атомов, делающая его истинным или ложным…

Тогда такая теория, как квантовая механика, изначально была бы бессмысленной, поскольку нет никакого способа распределить атомы так, чтобы сделать её истинной.

И наше открытие, что Вселенная состоит не из атомов, а из квантовых полей, обратило бы все осмысленные утверждения во всём мире в бессмысленные — потому что оказалось бы, что нет никаких атомов, которые можно было бы перераспределить, чтобы выполнить их условия истинности.

Подумайте над вопросом: Какое правило могло бы ограничить наши убеждения только теми, которые могут иметь смысл, не отсекая при этом раньше времени ничего, что в принципе может быть истинным?

Рациональность как привязанность к алгоритмам познания

Существует распространённая ошибка (которая меня довольно сильно раздражает), когда человек начинает вещать о важности «Истины». Обычно при этом подразумевается, что Истина — это нечто возвышенное, а не какие-нибудь скучные мирские истины о гравитации, радугах или о том, что ваш коллега сказал о вашем начальнике.

Поэтому довольно полезно упражняться в том, чтобы убирать слово «истина» из всех предложений, где оно появляется. (Замечу, что это один из видов рационалистского табуирования.) Например, вместо утверждения «Я считаю, что небо синее, и это истина!» можно просто сказать «Небо синее». Собеседник при этом получит совершенно одинаковую информацию о том, какой цвет неба с вашей точки зрения. А если утверждения «Я считаю, что демократы выиграют выборы» и «Демократы выиграют выборы» ощущаются для вас по-разному, то это важный сигнал о расхождении ваших сознательных и интуитивных убеждений.

Попробуйте попрактиковаться на следующих утверждениях:

- Я считаю, что Джесс пытается лишь выиграть спор.

- Истина в том, что ты невнимателен.

- Я считаю, что у меня всё наладится.

- На самом деле учителя очень заботятся об учениках.

Если «истина» определяется как бесконечное семейство предложений вида «Предложение „небо синее“ истинно тогда и только тогда, когда небо синее», то зачем нам вообще рассуждать об «истине»?

Мы не сможем убрать «истину» из предложения «Истинные убеждения с большей вероятностью позволяют делать предсказания, подтверждаемые экспериментом». Это предложение говорит о свойствах связи между картой и территорией. Словосочетание «истинные убеждения» можно заменить на «точная карта», однако это будет отсылкой к тому же понятию.

Слово «истина» можно удалить из большинства предложений лишь потому, что эти предложения не говорят ничего о связи между картой и территорией.

Теперь зададимся вопросом: когда необходимо использовать слово «рациональный»?

Как и в случае слова «истина», существует очень мало предложений, в которых действительно необходимо слово «рациональный». Рассмотрим следующие упрощения. Ни при каком из них практически не происходит потери информации.

-

«Рационально считать, что небо синее».

-> «Я думаю, что небо синее».

-> «Небо синее». -

«Рациональное питание: почему стоит придерживаться палеодиеты»

-> «Почему вы должны считать, что палеодиета приведёт к самым лучшим последствиям для здоровья».

-> «Мне нравится палеодиета».

Практически всегда, когда люди объявляют что-то рациональным, можно без потери смысла заменить это слово словом «оптимальный». В тех случаях, когда речь идёт об убеждениях, а не стратегиях, — словами «истинный» или чем-то вроде «я считаю, что это так».

Попробуйте попрактиковаться на следующих утверждениях:

- «Рационально учить детей дифференцировать и интегрировать».

- «По-моему, это самая рациональная книга на свете».

- «Рационально верить в гравитацию».

Подумайте над вопросом: В каких редких случаях из предложения нельзя убрать слово «рациональный»?

…

…

…

Ответ: Слово «рациональный» нам нужно, чтобы разговаривать о когнитивных алгоритмах или мыслительных процессах, обладающих свойствами «систематически улучшают связь между картой и территорией» (эпистемическая рациональность) или «систематически обеспечивают лучшие пути к цели» (инструментальная рациональность).

Например:

»(Эпистемически) рационально придерживаться гипотез, которые позволяют делать предсказания лучше».

или

«Цепляться за невозвратные затраты (инструментально) иррационально».

Из этих предложений нельзя убрать понятие рациональности без потери смысла. Можно найти способ перефразировать их без использования слова «рационально», однако придётся передавать то же самое понятие другими словами. Например:

«Если вы больше придерживаетесь гипотез, которые позволяют делать предсказания лучше, то ваша карта со временем лучше соответствует реальности».

или

«Если вы цепляетесь за невозвратные потери, вам это будет мешать достигать своих целей».

Слово «рационально» подходит для разговора о когнитивных алгоритмах, которые систематически улучшают связь карты и территории или помогают достижению целей.

Аналогично, рационалист — это не просто человек, который уважает Истину.

Слишком многие уважают Истину.

Некоторые уважают Истину о том, что правительство США заложило взрывчатку во Всемирный торговый центр, Истину о том, что судьбу человека решают звёзды (забавно, но если всё пойдёт как надо, правдой окажется противоположное утверждение), Истину о том, что глобальное потепление — это ложь, и так далее.

Рационалист — это человек, который уважает процессы поиска истины. Рационалисты — это люди, которые демонстрируют настоящее любопытство, даже если это любопытство касается давно всем понятных вопросов, вроде взрывчатки во Всемирном торговом центре. Ведь истинное любопытство — это часть излюбленного алгоритма и уважаемого процесса. Рационалисты уважают Стюарта Хамероффа за попытки проверить, действительно ли в нейронах могут происходить квантовые вычисления, пусть даже эта идея априори кажется крайне маловероятной и появилась как следствие ужасного гёделевского аргумента о том, что мозг не может быть механизмом. Однако Хамерофф попытался проверить свои странные убеждения экспериментально. И если бы «странные» убеждения никогда не проверялись экспериментально, человечество до сих пор обитало бы в саванне.

Или вспомним полемику о том, как CSICOP (Комитет по научному расследованию заявлений о паранормальных явлениях) разбирался с так называемым эффектом Марса. Эта полемика привела к тому, что CSICOP покинул его основатель, Деннис Роулинз. Действительно ли положение планеты Марс в небе во время часа рождения человека влияет на то, станет ли он знаменитым атлетом? Я скажу «нет», пусть даже кто-нибудь со мной не согласится. И если вы уважаете лишь Истину, то совершенно не важно, что CSICOP в процессе повысил требования к астрологу Гоклену — в смысле, объявил об эксперименте, а затем придумал новые причины отвергнуть результаты Гоклена, после того, как они оказались положительными. Выводы астролога почти наверняка неверны, конечно же, эти выводы отвергли, Истина восторжествовала.

Однако рационалиста волнуют утверждения, которые нарушают процессы рациональности. Байесианец в ситуации, похожей на описанную чуть-чуть сместил бы свои убеждения в сторону астрологии, однако априорные шансы против астрологии слишком велики. В большей степени байесианец сместил бы свои убеждения в сторону того, что Гоклен случайно наткнулся на какое-то явление, которое стоит исследовать подробнее. И уж точно он не стал бы требовать эксперимента, а затем игнорировать результаты или, когда результаты оказались не такими, как он ожидал, придумывать оправдания, почему эксперимент был неправильным. Такое поведение систематически плохо влияет на поиски истины. А рационалист ценит не просто красоту Истины, но красоту процессов и алгоритмов познания, позволяющих её находить.

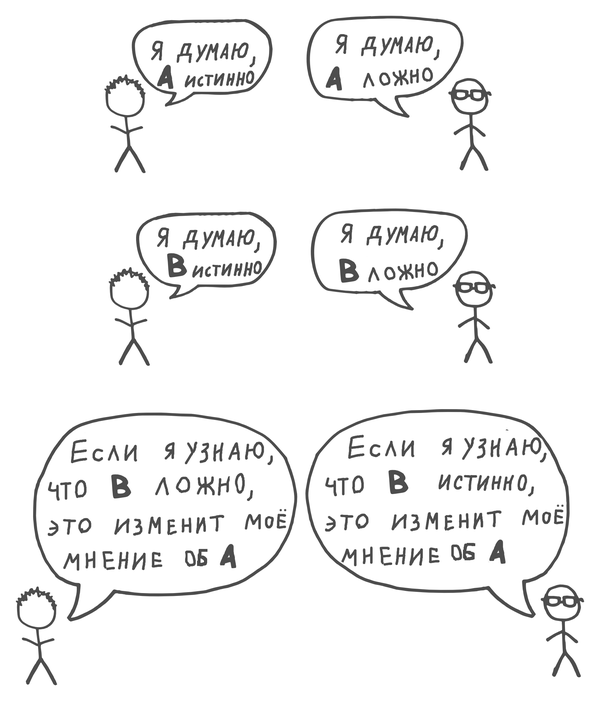

У рационалистов получается вести необычайно продуктивные и дружественные разговоры (по крайней мере, пока всё идёт нормально) не потому, что все участники очень сильно уважают то, что они считают Верным или Оптимальным. В обычных условиях люди яростно спорят не потому, что знают правду, но не уважают её. Разговоры рационалистов (потенциально) более продуктивны в той степени, в какой все участники уважают процесс и соглашаются, каким именно этот процесс должен быть - что достигается явным изучением предметов вроде когнитивной психологии и теории вероятностей. Когда Анна говорит мне: «Меня беспокоит, что, судя по всему, тебе не слишком любопытен этот вопрос», речь идёт о состоянии ума, которое мы оба считаем важным. И я понимаю, что когда уважаемая мной рационалистка говорит мне, что я должен проявить любопытство, я должен задуматься, оценить свой уровень любопытства и попытаться его увеличить. Это часть рационалистского процесса, и она находится на мета-уровне относительно конкретного обсуждаемого вопроса.

Нужно ли любить рациональность, чтобы её использовать? Я могу представить мир, в котором миллионы людей учатся в школе правильно использовать Искусство, но лишь горстка любит его настолько, что пытается его развивать, а все остальных Искусство интересует лишь в связи с практическими результатами. Точно также я могу представить компетентного прикладного математика, который работает на инвестиционный фонд исключительно ради денег - он никогда не любил ни математику, ни программирование, ни оптимизацию. Я могу представить компетентного музыканта, который не испытывает особой любви к композиции или наслаждения от музыки, и которого заботит лишь продажа альбомов и поклонницы. Если какое-то явление можно вообразить, это ещё не означает, что его вероятно встретить в реальной жизни… Однако, если где-то существуют множество детей, которые учатся играть на фортепьяно, хотя и не любят это занятие, «музыкантом» будет считаться тот, кто играет необычайно хорошо, а не просто нормально.

Однако пока в нашем мире, где Искусство ещё ни навязывается насильно школьникам, ни приносит явного вознаграждения на обыденном карьерном пути, почти все владеющие какими-то рациональными навыками — это люди, которых захватывает Искусство само по себе. И это — возможно, тут стоит сказать «увы» — многое объясняет, как о рационалистских сообществах, так и о мире.

Навык: Карта — не территория

Самая ранняя известная мне рационалистская фантастика — это серия «Нуль-А» Альфреда ван Вогта. (Я знаю всего два примера рационалистской фантастики, не произошедшей от «ГПиМРМ», и второй — это «Праща Давида» Марка Стиглера.) У главного героя книг ван Вогта, Гилберта Госсейна, множество невоспроизводимых способностей: хотя они якобы относятся к мыслительным, вы не в состоянии им научиться. Например, благодаря своим тренировкам, герой умеет использовать всю свою силу в чрезвычайных ситуациях. Главный же рационалистский навык, которому, читая о приключениях Госсейна, научиться всё-таки можно, заключён в его девизе:

Карта — не территория.

Меня до сих пор иногда поражает мысль, что эту поговорку пришлось придумать: это сделал парень по фамилии Коржибски, причём лишь в двадцатом веке. Я читал книги ван Вогта в раннем детстве, поэтому для меня эта фраза звучит как аксиома, без которой существовать невозможно.

Однако поскольку Байесовский заговор вступает во вторую стадию своего развития, мы должны приучиться переводить просто красивые мысли в техники, которые можно применить на практике. Начнём.

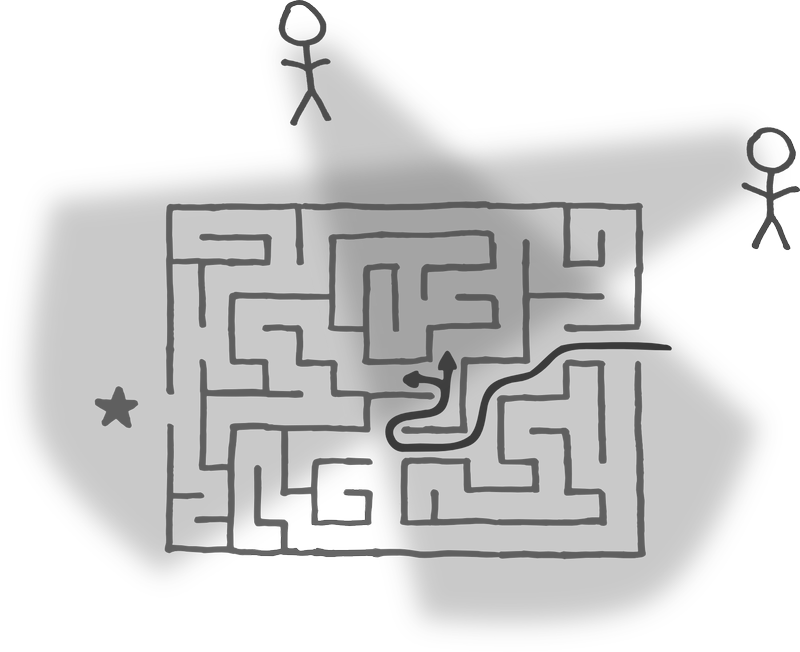

Подумайте над вопросом. При каких обстоятельствах полезно осознанно думать о различиях между картой и территорией, то есть осознанно представлять мысленный пузырь, содержащий убеждение, и реальность вокруг него вместо того, чтобы с помощью карты напрямую размышлять о реальности? Как именно это поможет и в каких задачах?

…

…

…

Навык 1. Вообразить собственную неправоту.

В книге ван Вогта Гилберт Госсейн вспоминает о поговорке про карту и территорию, когда не уверен в каких-то убеждениях: «Ты так считаешь, но мир не обязательно так устроен». Это высказывание может казаться базовой истиной, но именно с него часто начинается обучение начинающих рационалистов. Они прыгают из мира, где небо просто синее, трава просто зелёная, а люди из Другой Политической Партии просто одержимы злобными демонами, в мир, где, возможно, реальность не совпадает с этими убеждениями и способна когда-нибудь вас удивить. В случае «трава зелёная» этому можно присвоить достаточно низкую вероятность, однако в мире, где территория отделена от карты по крайней мере допустимо, что однажды реальность не согласится с вами. Некоторые люди способны практиковать этот навык. Например, в случаях, когда им хочется полностью отвергнуть вероятность, что, возможно, они ошибаются, эти люди мысленно представляют себя сначала в мире, где их убеждения верны, а потом в мире, где их убеждения неверны. Убеждения относительно мотивов других людей — например, «Он меня ненавидит!» — судя по всему, лучше перефразировать как: «Я считаю, что он меня ненавидит» или «Я предполагаю, что он меня ненавидит». Результат иногда получается гораздо лучше.

По тем же причинам часто помогает рассуждение на языке вероятностей. Если вероятность Х — 75%, значит вероятность не-Х — 25%. Таким образом вы автоматически рассматриваете больше одного мира. Присваивание вероятностей также неминуемо напоминает, что сейчас вы работаете лишь со знаниями о мире. Ведь вероятностными могут быть лишь убеждения. Реальность всегда либо одна, либо другая.

Навык 2. Рассмотреть убеждение с другой точки зрения.

Если мы действительно в чём-то убеждены, нам кажется, что мир такой и есть. Если смотреть изнутри, другим людям кажется, что они живут в другом мире, не в таком же, как вы. Другие не соглашаются с вами не потому, что они беcпричинно упрямы, они не соглашаются, потому что ощущают мир по-другому, пусть даже вы и находитесь в одной и той же реальности.

Книга «Гарри Поттер и методы рационального мышления» написана, в том числе, с использованием этого навыка. Когда я создавал того или иного персонажа, например, Драко Малфоя, я не просто представлял, как он думает, я представлял окружающий его субъективный мир, который вращается вокруг него. Всё остальное считалось важным (или вообще принималось во внимание) лишь в зависимости от того, насколько оно важно для этого персонажа. Большинство книг показывают лишь одну точку зрения. Часто, даже если в книге представлено несколько точек зрения, второстепенные персонажи живут во вселенной главного героя и думают в основном о том, что важно главному герою. В «ГПиМРМ», когда вы встаёте на место Драко Малфоя, вас выдёргивают в субъективную вселенную Драко Малфоя, где у Пожирателей Смерти есть веские причины для их действий, а Дамблдор — внешнее беспричинное зло. Поскольку я не планировал писать постмодернистское произведение, персонажи всё же определённо жили в одной и той же реальности и оправдания действий Пожирателей Смерти убедительно звучали лишь для Драко — я не старался их как-то улучшить, чтобы убедить читателя. Речь не идёт о том, что каждый персонаж в буквальном смысле живёт в своей вселенной, и не о том, что все стороны моральны в равной степени, что бы они не делали. Речь о том, что разные элементы реальности для разных персонажей имеют разный смысл и разное значение.

Джошуа Грин однажды заметил (кажется, это было в его статье «Ужасная, кошмарная, нехорошая, очень плохая мораль»), что дискуссии о политике почти всегда выглядят как чтение нотаций непослушным детям, отказывающимся признавать очевидные истины. Отмечу, что если ошибающийся не в состоянии проверить свои убеждения экспериментально, то он может внутренне ощущать себя также, как и в тех случаях, когда он прав.

Навык 3. Вы с меньшей вероятностью примете анти-эпистемологию и подход «мотивированной нейтральности», утверждающие, что истины не существует.

Это навык избегания: он не позволяет принять решение о том, что именно делать, а лишь указывает на один из многих способов совершить ошибку. При обучении стоит уделять меньше внимания подобным навыкам. Тем не менее, если вы уже потратили какое-то время на то, чтобы представить Салли и Анну с их разными убеждениями, а также как с их убеждениями соотносится положение мячика, вам легче не поддаться на чьи-то рассуждения об отсутствии объективной истины. Салли и Анна представляют мир по-разному, но реальность — настоящее положение мячика, — с которой сравниваются их убеждения, лишь одна, поэтому здесь нет «различных правд». Настоящее убеждение (в отличие от веры в убеждение) всегда ощущается как верное, и, да, действительно, у двух людей действительно могут быть разные ощущения истины, но ощущение истины — не территория.

Предположу, что для усвоения этого навыка стоит замечать, когда ты сталкиваешься с подобной анти-эпистемологией, и, возможно, представлять в ответ две фигуры в мысленных пузырях и их единое окружение. Впрочем, по-моему, большинству людей, которые понимают основную идею, не нужны дополнительные аргументы и тренировки, чтобы избежать описанной ошибки.

Навык 4. Принимать решения, рассуждая о последствиях для мира (метод Тарского, он же литания Тарского).

Предположим, вы размышляете, стоит ли стирать свои белые спортивные носки с тёмными вещами. Вы беспокоитесь, что носки могут покраситься, но, с другой стороны, вам очень не хочется запускать стиральную машину второй раз только из-за белых носок. Не исключено, что ваш мозг начнёт придумывать причины, почему вряд ли с вашими носками что-то произойдёт — например, скажет, что тут же нет совсем новых тёмных вещей. В таких случаях помогает литания:

Если на моих носках появятся пятна, я хочу верить, что на носках появятся пятна.

Если на моих носках не появятся пятна, я хочу верить, что на носках не появятся пятна.

Я не буду цепляться за веру, которую не хочу.

Чтобы ваш мозг прекратил убеждать сам себя, представьте, что вы уже в мире, где ваши носки в результате стирки потемнеют, или уже в мире, где с ними ничего не случится, и в обоих случаях вам лучше считать, что вы находитесь именно в том мире, в котором находитесь. Помогают мантры: «То, что может быть разрушено правдой, должно быть разрушено» и «Реальность — это то, что не исчезает, когда вы прекращаете в неё верить». Признание, что убеждение — это ещё не реальность, может помочь нам признать первичность реальности и либо перестать с ней спорить и принять её, либо проявить любопытство.

Анна Саламон и я обычно используем метод Тарского так: мы представляем мир, который нам не нравится или который отличается от наших убеждений, в нём себя, который верит в противоположное, и катастрофу, которая в результате последует. Например, представьте, что вы уже какое-то время едете на машине, вы до сих пор не доехали до своего отеля и начинаете беспокоиться, не пропустили ли вы нужный поворот. Если вы его всё-таки пропустили, вам придётся разворачиваться и ехать ещё 60 километров в противоположном направлении, а это очень неприятная мысль и ваш мозг изо всех сил пытается убедить себя, что вы не заблудились. Анна и я в этом случае представим мир, где мы заблудились, но продолжаем ехать вперёд.

Замечу, что это всего лишь одна из ячеек в матрице 2 х 2:

| На самом деле вы едете в нужном направлении | На самом деле вы заблудились | |

| Вы считаете, что едете в нужном направлении | Не надо ничего менять: просто продолжаете движение и вы приезжаете в отель на свою конференцию | Просто продолжаете движение и в какой-то момент заезжаете на своей арендованной машине в море |

| Вы считаете, что вы заблудились | Увы! Вы тратите целых пять минут своей жизни на ненужные вам распросы | Вы тратите пять минут на расспросы, разворачиваетесь и едете 40 минут в противоположном направлении |

Майкл «Валентайн» Смит говорит, что он применяет обсуждаемый навык, представляя все четыре ячейки по очереди. Практика позволяет делать это очень быстро, и он считает, что представлять все варианты полезно.

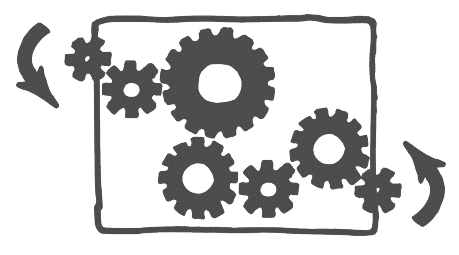

Рациональность как боевое искусство

Мне очень нравится метафора, что рациональность — это боевое искусство для разума. Чтобы изучать боевые искусства, не обязательны огромные мускулы. Безусловно, люди спортивного телосложения чаще занимаются боевыми искусствами, однако боевые искусства можно изучать по самым разным причинам, в том числе и ради удовольствия. Если у вас есть рука, и все сухожилия и мускулы на месте, вы можете научиться сжимать кулак.

Аналогично, если у вас есть мозг, и с корой больших полушарий всё в порядке, вы можете научиться правильно его использовать. Если у вас есть способности, наверное, вы научитесь быстрее. Однако, искусство рациональности — это не про скорость обучения. Искусство рациональности — это тренировки машины, которая есть в голове у каждого из нас. Наши мозги склонны совершать систематические ошибки (как пример такой ошибки можно привести пренебрежение масштабом). Рациональность предназначена, чтобы исправлять такие ошибки или находить способы их обойти.

Увы, наш разум подчиняется нашей воле гораздо хуже, чем руки. По меркам эволюции способность управлять мускулами у нас появилась очень давно, способность же рассуждать о собственном процессе рассуждения — гораздо более свежее изобретение. Таким образом не стоит удивляться, что применять мускулы гораздо проще, чем применять мозги. Однако вряд ли разумно пренебрегать тренировками только потому, что они сложные. Люди захватили Землю не благодаря большим мускулам.

Если вы живёте в городе, наверняка у вас где-нибудь поблизости есть школа боевых искусств. Почему нет таких школ, где обучают рациональности?

Наверное, одна из причин заключается в том, что в рациональности сложно определить наличие навыков. Чтобы перейти на следующий уровень в тхэквондо, обычно нужно сломать доску определённой толщины. Если у вас получилось, все наблюдатели аплодируют. Если у вас не получилось, ваш учитель смотрит, как вы сжимаете кулак, и проверяет, правильно ли вы это делаете. Если неправильно, учитель вытягивает руку, сжимает кулак правильно и вы можете понаблюдать, как надо делать.

В школах боевых искусств техники владения мускулами вырабатывались и оттачивались поколениями. Передать техники рациональности гораздо сложнее, даже если ученик очень-очень хочет их освоить.

Совсем недавно — меньше полувека назад — люди узнали довольно много нового о человеческой рациональности. Например, экспериментальная психология рассказала об эвристиках и искажениях — наверное, это самое важное знание. Также появилась байесианская систематизация теории вероятностей и статистики, произошли новые открытия в эволюционной и социальной психологии. Мы получили эмпирические данные о человеческой психологии, у нас есть теория вероятностей, чтобы интерпретировать результаты экспериментов, и теория эволюции, чтобы объяснять результаты. Всё это дало нам новые способы заглянуть в наш собственный разум. С помощью этих наук мы теперь способны более чётко разглядеть «мускулы» наших мозгов и «пальцы» наших мыслей. У нас появился общий словарь для описания задач и их решений. Человечество может наконец построить боевое искусство для разума: придумать техники личной рациональности, делиться ими, систематизировать их и передавать следующим поколениям.

Я стал лучше понимать рациональность благодаря своим попыткам решать задачи, связанные с сильным искусственным интеллектом (чтобы по-настоящему построить работающего рационалиста из подручных материалов придётся самому овладеть рациональностью на достаточно высоком уровне). Зачастую задачи, связанные с ИИ, требуют намного большего, чем искусство личной рациональности, но иногда этого может хватить. Чтобы овладеть боевым искусством для разума нам нужно научиться в нужное время нажимать на нужные рычаги в гигантской уже существующей думающей машине, внутренности которой мы не в состоянии изменить. Часть этой машины оптимизирована в результате эволюционного отбора для достижения целей, которые противоречат нашим собственным. Мы объявляем, что нас интересует только правда, но в наши мозги зашит механизм рационализации лжи. То, что мы считаем недостатками машины, мы можем попробовать компенсировать, но мы не в состоянии по-настоящему перестроить наши нервные цепи. Впрочем, мастера боевых искусств тоже не в состоянии заменить свои кости титановыми, во всяком случае, пока.

Попытка создать искусство личной рациональности, опираясь на науку о рациональности, может показаться глупой. Кто-нибудь скажет, что это всё равно что пытаться изобрести боевое искусство на основе теоретической физики, теории игр и анатомии человека.

Однако люди способны к рефлексии. У нас есть природная склонность к интроспекции. Мы в состоянии заглянуть внутрь себя, пусть даже наше внутреннее зрение склонно к систематическим искажениям. Таким образом, нам нужно разобраться, что говорит наука по поводу нашей интуиции, с помощью абстрактных знаний исправить ход наших мыслей и улучшить наши метакогнитивные навыки.

Мы не пишем компьютерную программу, чтобы заставить марионетку показывать приёмы боевых искусств. Мы должны заставить двигаться «конечности» нашего собственного мозга. Для этого нам нужно связать теорию с практикой. Нужно выяснить, как использовать науку для нас самих, для повседневной работы нашего разума.

Знание задним числом

Знание задним числом это искажение, при котором люди, знающие ответ, значительно переоценивают его предсказуемость или очевидность в сравнении с оценками тех, кто данный ответ заранее не знает. Иногда это искажение называют эффектом «я-знал-это-наперед».

Фишхофф и Бейт [Fischhoff и Beyth, 1975] представили студентам исторические отчеты о малоизвестных событиях, таких, как конфликт между гуркхами и англичанами в 1814 году. Пять групп студентов, получивших эту информацию, были опрошены в отношении того, как бы они оценили степень вероятности каждого из четырех исходов: победа англичан, победа гуркхов, патовая ситуация с мирным соглашением или пат без соглашения. Каждое из этих событий было описано как реальный итог ситуации одной из четырех экспериментальных групп. Пятой, контрольной группе, о реальном исходе не говорили ничего. Каждая экспериментальная группа приписала сообщенному ей итогу гораздо большую вероятность, чем любая другая или контрольная группа.

Эффект знания «задним числом» важен в суде, где судья или присяжные должны определить, виновен ли обвиняемый в преступной халатности, не предвидев опасность. [Sanchiro, 2003]. В эксперименте, основанном на реальном деле, Камин и Рахлинский [Kamin and Rachlinski, 1995] попросили две группы оценить вероятность ущерба от наводнения, причиненного закрытием принадлежащего городу разводного моста. Контрольной группе сообщили только базовую информацию, бывшую известной городу, когда власти решили не нанимать мостового смотрителя. Экспериментальной группе была дана эта же информация плюс сведения о том, что наводнение действительно случилось. Инструкции устанавливают, что город проявляет халатность, если поддающаяся предвидению вероятность наводнения больше 10 процентов. 76 % опрашиваемых из контрольной группы заключили, что наводнение было настолько маловероятным, что никакие предосторожности не были нужны. 57 % экспериментальной группы заключили, что наводнение было настолько вероятно, что неспособность принять меры предосторожности была преступной халатностью. Третьей группе сообщили итог и также ясным образом инструктировали избегать оценки задним числом, что не привело ни к каким результатам: 56 % респондентов этой группы заключили, что город был преступно халатен.

Рассматривая историю сквозь линзы нашего последующего знания, мы сильно недооцениваем затраты на предотвращения катастрофы. Так, в 1986 году космический челнок Челленджер взорвался по причине того, что кольцевой уплотнитель потерял гибкость при низкой температуре [Rogers, 1986]. Были предупреждающие сигналы о проблемах, связанных с кольцевым уплотнителем. Но предотвращение катастрофы Челленджера должно было потребовать не только внимания к проблемам с кольцевым уплотнителем, но и озабоченности каждым аналогичным предупреждающим сигналом, который бы казался столь же серьезным, как проблема уплотнителей, без преимущества последующего знания.

Вскоре после 11 сентября я подумал про себя, что сейчас кто-либо вспомнит про предупреждавшие сигналы разведки или наподобие этого, после чего знание задним числом начнет свою работу. Да, я уверен, что были предупреждения об Аль-Каиде, но вероятно были такие же предупреждения и об активности мафии, незаконной продаже ядерных материалов и вторжении с Марса.

Поскольку мы не видим цену всей картины, мы склонны выучивать только частные уроки. После 11 сентября Федеральное авиационное агенство запретило пользоваться на самолетах ножами для бумаг - словно бы проблема заключалась в том, что была пропущена эта частная «очевидная» мера предосторожности. Мы не выучили главный урок: цена эффективных мер предосторожности крайне высока, поскольку вам нужно стараться понять, что проблемы не так очевидны, какими кажутся прошлые трудности в свете знания задним числом.

Тестирование модели подразумевает под собой рассмотрение, насколько вероятен наблюдаемый исход. Знание задним числом систематически искажает этот тест; мы думаем, что у нашей модели больше вероятность быть истинной, чем на самом деле. И простое знание об этом когнитивном искажении не помогает убрать его влияние. Вам нужно выписывать ваши предсказания заранее. Или как говорит Фишхофф (1982):

Когда мы пытаемся понять прошлые события, мы неявно тестируем гипотезы или правила, которые используем для интерпретации и предсказания мира вокруг нас. Если, в свете знания задним числом, мы систематически недооцениваем сюрпризы, которые прошлое готовило и готовит для нас, мы подвергаем эти гипотезы слишком слабым тестам, и, возможно, не находим достаточно причины менять их.

Пример предвзятого продолжения

Я могу понять многих комментирующих в «Пытки против песчинок в глазу»(English), которые утверждают, что предпочтительней песчинки в глазах у 3^^^3 (удивительное большое, но конечное число) людей, чем пятидесятилетняя пытка одного человека. Если вы думаете, что песчинка просто не имеет значения, пока нет других посторонних эффектов — если вы буквально не предпочитаете отсутствие песчинки ее наличию — тогда ваша позиция последовательна. (Хотя я подозреваю, что многие сторонники песчинок выразили бы иное предпочтение, если бы не знали о жале дилеммы.)

Так что хоть я и на стороне тех, кто выбирает ПЫТКУ, но я могу понять и тех, кто выбирает ПЕСЧИНКИ.

Но некоторые из вас говорят, что вопрос бессмысленен; или что вся мораль относительна и субъективна; или что вам нужно больше информации, прежде чем вы можете решить; или вы говорите о других запутывающих аспектах проблемы; и тогда вы не хотите выражать свои предпочтения.

Простите. Не могу поддержать вас в этом.

Если вы на самом деле отвечаете на дилемму, тогда не имеет значения какой выбор вы сделаете, все равно придется от чего-то отказаться. Если вы скажете ПЕСЧИНКИ, вы откажетесь от вашего утверждения на основании определенного вида утилитаризма; вы можете волноваться, что вы недостаточно рациональны, или что другие обвинят вас в приверженности большим числам. Если вы скажете ПЫТКА, вы примете исход, что там есть пытка.

Я фальсифицируемо предсказываю, что большинство тех, кто уходит от ответа, на самом деле уже знают свой ответ — либо ПЫТКА, либо ПЕСЧИНКИ — от высказывания которого они уходят. Возможно просто на долю секунды прежде чем запутывающе-вопросная операция закончится, но я предсказываю, что уход есть. (для большей конкретности: я не предсказываю, что вы знали и выбрали и имели в сознании прямо сейчас некоторый определенный ответ, который осознанно не даете. Я предсказываю, что ваше мышление склонно к определенному неудобному ответу, по крайней мере на долю секунды, прежде чем вы начнете искать причины, чтобы поставить под вопрос саму дилемму.)

В дискуссиях на тему биоэтики, вы очень часто можете видеть экспертов, обсуждающих то, что они видят как за и против, скажем, для исследований по стволовым клеткам; и тогда, в заключение своей речи, они рассудительно объявляют, что срочно требуется больше обсуждений, с участием всех заинтересованных сторон. Если вы на самом деле приходите к некому заключению, если вы на самом деле делаете вывод, что нужно запретить эти исследования, то на вас ополчатся родственники умирающих от болезни Паркинсона. Если вы выскажетесь за продолжение исследований, то на вас обрушится гнев религиозных фундаменталистов. Но кто будет спорить с призывом к дальнейшим обсуждениям?

Не нравится то, к чему ведут свидетельства в споре дарвинистов и креационистов? Рассмотрите вопрос трезво и решите, что нужно больше свидетельств; вы хотите, чтобы археологи нашли еще миллиард окаменелостей, прежде чем вы придете к единому выводу. Таким образом вы никогда не скажете ничего кощунственного, и в то же время не порушите свой образ как рационалиста. Продолжайте делать это во всех вопросах, которые могут выглядеть как ведущие в неудобном направлении, и вы сможете поддерживать в своем сознании всю религию.

Настоящая жизнь часто запутана, и нам приходится выбирать все равно, поскольку отказаться от выбора — это тоже выбор. План ничего не делать — это тоже план. Мы всегда что-то делаем, даже бездействуя. Как сказали Рассел и Норвиг, «Отказываться выбирать это все равно что отказываться, чтобы время шло».

Уворачиваться от неудобных выборов — опасная привычка для сознания. Есть определенные случаи, когда мудро отложить суждение (на час, но не на год). Но когда вы встаете перед дилеммой, где все ответы кажутся неподходящими, это не такой случай! Выберите один из неудобных ответов как наилучший по степени неудобности. Если информации недостает, заполните пробелы правдоподобными предположениями или вероятностными распределениями. Делайте все, что угодно, чтобы превозмочь простой уход в сторону от неудобства. Поскольку при этом вы просто пытаетесь убежать.

Пока вы не выбрали промежуточное лучшее предположение, неудобство будет поглощать ваше внимание, отвлекать вас от поиска, искушать вас запутаться в вопросе всякий раз, когда ваш анализ будет приводить вас к определенному направлению.

В реальной жизни, когда люди уклоняются от неудобных выборов, они часто вредят другим точно так же, как и себе. Отказаться от выбора очень часто наихудший выбор, который вы можете сделать. Предвзятое продолжение — это не привычка мышления которую кто-либо может себе позволить, независимо от того, эгоист это или же альтруист. Цена удобства слишком велика. Важно овладеть привычкой стискивать зубы и выбирать — так же важно как впоследствии искать лучшие альтернативы.

31 закон удовольствия

«Утопия? Вот это? Надо же…

По-моему, на Ад походит больше».

сэр Макс Бирбом, стихотворение, названное

«Надпись на экземпляре Утопии Мора (или Шоу, или Уэллса, или Платона, или кого угодно другого)»

Это краткое изложение цепочки «Теория удовольствия». Оно состоит из советов для авторов или футурологов, желающих описать мир, в котором людям действительно хотелось бы жить. Вся теория осталась «за кадром».

-

Подумайте о типичном дне человека, который живёт в Утопии уже не первый день. Не зацикливайтесь на первых мгновениях «о-я-услышал-хорошую-новость». Усталый, измученный бедностью крестьянин обрадуется, услышав в раю, что «тебе больше не нужно работать, а улицы вымощены золотыми плитками!», но, скорее всего, спустя пару месяцев он уже будет не настолько счастлив от этого. (Prolegomena to a Theory of Fun1.)

-

Хорошо подумайте перед тем, как внедрять в вашу Утопию какие-то занятия, которые вы считаете обязательными, хотя они не являются приятными. Взгляните на тот же христианский рай: пение гимнов не выглядит сверхудовольствием, но раз молитвой положено наслаждаться, никто не заостряет на этом внимание. (Prolegomena to a Theory of Fun.)

-

Упрощение компьютерной игры не всегда её улучшает. То же самое верно и для жизни. Думайте не о полном уничтожении работы, а о том, как избавить людей от «низкокачественной» рутины, чтобы они могли заниматься «высококачественными» сложными делами. (High Challenge.)

-

В жизни нужны новые ощущения и опыт, и лучше, чтобы он учил чему-то новому. Если новый опыт поступает слишком медленно (по сравнению со скоростью его усвоения и обобщения), будет скучно. (Complex Novelty.)

-

Люди должны умнеть со скоростью, достаточной для интеграции старого опыта. Но они не должны умнеть настолько быстро, что им некуда будет применить свой новый интеллект. Чем умнее человек, тем быстрее ему становится скучно, но умный человек может решать задачи, которых раньше просто не понимал. (Complex Novelty.)

-

Люди должны жить в мире, в котором их чувства, тела и мозги используются на полную катушку. Либо мир должен больше напоминать первобытную саванну, чем, скажем, офис без окон, либо мозги и тела должны быть модифицированы, чтобы различные разновидности сложных задач и окружений задействовали их полностью. (Для развлекательной фантастики предпочтителен первый вариант.) (Sensual Experience.)

-

Тимоти Феррисс писал: «Что противоположно счастью – горе? Нет. Любовь и ненависть – две стороны одной и той же монеты, то же самое справедливо для счастья и горя… Антитеза любви – безразличие, противоположность счастья – скука, в том-то и вся загвоздка… Следует задаваться не вопросами „Чего я хочу?“ или „В чем заключается моя цель“, а вопросом „Что по-настоящему увлекает меня?“… „Жить как миллионер“ – значит заниматься интересными делами, а не просто владеть имуществом, вызывающим зависть».2 (Existential Angst Factory.)

-

Жизнь каждого человека должна становиться всё лучше и лучше. (Continuous Improvement.)

-

Вам не надо точно знать, что именно станет лучше в будущем, но вы должны постоянно пытаться это предсказать. В итоге будущее должно оказаться приятным сюрпризом. (Justified Expectation of Pleasant Surprises.)

-

Наши предки, охотники и собиратели, сами мастерили свои луки, плели свои корзины и строгали свои флейты. Затем они самостоятельно охотились, собирали и играли свою музыку. В Утопиях будущего часто изображается всё больше и больше удобных кнопок, но что именно они делают — понятно всё меньше и меньше. Не спрашивайте о том, что Утопия может сделать для людей. Подумайте лучше, чем интересным могут заниматься её жители — используя свой мозг, своё тело и понятные им инструменты. (Living By Your Own Strength.)

-

Живя в Эутопии3, люди должны становиться сильнее, а не слабее. Её обитатели должны впечатлять больше, чем обитатели нашего мира, а не наоборот. (Living By Your Own Strength. Также см. Цуёку наритаи.)

-

Жизнь не должна дробиться на серию несвязанных между собой эпизодов, не имеющих долгосрочных последствий. Нельзя построить жизнь, играя в самые лучшие компьютерные игры, и неважно, насколько эти игры сложны и реалистичны. (Emotional Involvement.)

-

Люди должны сами вершить свою судьбу. В их жизни всегда должно оставаться место их планам, воображению и возможности управлять своим будущим. Нельзя делать граждан пешками в руках могучих богов, и тем более — их материалом для лепки. Есть простой способ решить эту проблему: мир должен работать по стабильным правилам, которые для всех одинаковы, и Эутопия должна держаться на хорошем выборе начальных правил, а не на каком бы то ни было оптимизационном давлении на жизни людей. (Free to Optimize.)

-

Человеческие разумы не должны играть на одном поле со значительно превосходящими их сущностями. Большинство людей не любит быть в тени. При взаимодействии с богами человек теряет статус «главного персонажа». Это нежелательно в фантастике, а возможно, и в реальной жизни. (См. “Нарния” К.С. Льюиса, “Культура” Иэна Бэнкса). Либо измените эмоциональную организацию людей так, чтобы они не чувствовали себя ненужными, либо не допускайте богов на их игровое поле. Художественное произведение, предназначенное для людей, не может использовать первый путь. (И в реальной жизни, вероятно, могут быть ИИ, не относящиеся ни к разумным, ни к мешающим. См. основной пост и предшествующее ему.) (Amputation of Destiny.)

-

Также сложно придумать, как человек может соревноваться на одном поле с ещё шестью миллиардами других людей. Наши первобытные предки жили в группах примерно по 50 человек. Сегодня же СМИ постоянно бомбардируют нас новостями о необычайно богатых и милых людях, и возникает ощущение, будто они живут по соседству. Однако очень немногие люди имеют шанс стать лучшими в чём бы то ни было. (Dunbar’s Function.)

-

Наши первобытные предки в какой-то степени могли по-настоящему влиять на политику своего племени. Сравните с современным миром национальных государств, в котором почти никто не знает Президента лично и не может убедить Конгресс в том, что он принял плохое решение. (Впрочем, это не мешает людям спорить так, будто они всё ещё живут в племени из полусотни человек.) (Dunbar’s Function.)

-

Слишком большой выбор не всегда оказывается благом (особенно, если люди не в состоянии получить предлагаемые возможности самостоятельно). Боль от потери сильнее, чем удовольствие от эквивалентного приобретения, и потому, если варианты выбора различаются по многим параметрам, а доступен только один вариант, люди будут фокусироваться на потере невыбранного. Если у людей есть способ избежать неких трудностей, то трудности кажутся менее серьёзными, даже если человек не пользуется этим способом. Также, к сожалению, люди предсказуемо совершают определённые ошибки. Не стоит думать, что больше вариантов — это всегда лучше, потому что «люди всегда могут просто сказать „нет“ ». Больше вариантов выбора обнадёжит лишь читателя художественной книги. «Не волнуйся, ты сделаешь выбор! Ты же доверяешь себе?» Однако жить в условиях большого выбора не всегда настолько забавно. (Harmful Options.)

-

Экстремальный пример для предыдущего пункта: постоянное искушение невероятно опасными соблазнами, вроде абсолютно реалистичного виртуального мир, или наркотик, дарующий невероятно приятные ощущения и вызывающий сильнейшую зависимость. Вы не сможете позволить себе ни минуты слабости. (См. трилогию Джона Райт «Золотой век»). (Devil’s Offers.)

-

Однако, если люди развиты настолько, что способны отстрелить себе ноги без посторонней помощи, останавливать их — это чересчур. Можно лишь надеяться, что он достаточно умны, чтобы это не делать, ведь к тому времени, когда они создают пистолет, они уже знают, что происходит при нажатии на курок, и им не нужно удушающее «защитное одеяло». Если это верно, то опасные возможности должны быть ограждены преградами соответствующей «высоты». (Devil’s Offers.)

-

Если сказать людям правду, до которой они пока не дошли самостоятельно, это не всегда им поможет. (Joy in Discovery.)

-

Мозг — одна из сложнейших штук во вселенной. Поэтому нам редко приходится взаимодействовать с чем-то сложнее, чем другие люди (другие разумы). И это взаимодействие уникально из-за эмпатии, которую мы испытываем друг к другу: наш мозг считает другие мозги чем-то похожим на себя, а не воспринимает их как большие и сложные машины, у которых нужно дёргать рычажки. Если людям нужно будет меньше взаимодействовать с другими людьми, сложность человеческого существования понизится. Это шаг в неверном направлении. Поэтому не стоит поддаваться искушению упростить жизнь людей, например, дав им идеальных искусственных сексуальных/романтических партнёров. (Interpersonal Entanglement.)

-

Однако следует признать, что статистически у людей есть проблемы с сексуальными взаимодействиями: распределение мужских характеристик не соответствуют распределению женских желаний и наоборот. Не всё в Эутопии должно быть просто, однако в ней не должно быть ничего бессмысленного и не должно быть разочарований, с которыми ничего нельзя поделать. (Это общий принцип.) Поэтому лучше подумать, как можно повлиять на распределения, чтобы задача оказалась разрешима, а не решать её взмахом волшебной палочки. (Interpersonal Entanglement.)

-

Вообще, менять мозги, разумы, эмоции и личные качества гораздо опаснее (и с точки зрения этики, и с точки зрения сложности), чем менять тела и условия обитания. Всегда стоит подумать, что вы можете сделать с окружающей средой, перед тем как придумывать изменения в сознании, а если уж решили заняться сознанием, начинайте с маленьких изменений. В противном случае за полётом вашей мысли не успеют не только ваши читатели, но и ваше собственное воображение. (Changing Emotions.)

-

В нашем мире наслаждение и боль не сбалансированы. Неопытный палач с простыми инструментами за тридцать секунд причинит больше боли, чем сверхискушенный секс-мастер сможет доставить удовольствия за тридцать минут. Один из вариантов — устранить этот дисбаланс: пусть в мире будет больше радости, чем печали. Боль допустима, но только не бесцельная бесконечная невыносимая боль. Наказание должно быть пропорционально ошибке: человек может коснуться горячей плиты и получить болезненный ожог, но он не должен оказываться в инвалидном кресле из-за того, что отвлёкся на пару секунд. Люди становятся сильнее и меньше мучаются. Также в этом варианте следует устранить боль, убивающую разум, и сделать удовольствия более доступными. Другой вариант — полное устранение боли. Возможно, с точки зрения реального мира у него есть серьёзные преимущества, но в художественной литературе его выбирать нельзя ни в коем случае. (Serious Stories.)

-

Джордж Оруэлл однажды заметил, что Утопии крайне озабочены тем, как бы избежать беспокойства. Не бойтесь написать громкую Эутопию, которая разбудит ваших соседей. (Eutopia is Scary, Джордж Оруэлл, «Почему социалисты не верят в счастье».)

-

Джордж Оруэлл также заметил, что «Жители идеальных вселенных не способны на спонтанное веселье и обычно отвратительно торгуются». Если в вашей истории персонажи ведут себя именно так, возможно, вы упустили что-то серьёзное и ситуацию нельзя исправить, обязав Государство нанять несколько клоунов. (Джордж Оруэлл, «Почему социалисты не верят в счастье».)

-

Если бы Бен Франклин попал в наше время, чему-то он бы удивился и обрадовался. Что-то наоборот показалось бы ему ужасающим и отвратительным, и не потому что наш мир развивался как-то неправильно, а потому что наш мир стал лучше по сравнению с эпохой Франклина. Очень мало вещей оказались бы именно такими, как он ожидал. Если вы воображаете мир, который кажется вам знакомым и комфортным, он мало кого вдохновит. Этот мир будет казаться ненастоящим. Попробуйте изобрести по-настоящему лучший мир, который шокировал бы вас (по крайней мере, поначалу), и в котором бы вы чувствовали себя не в своей тарелке (по крайней мере, поначалу). (Eutopia is Scary.)

-

Утопия и антиутопия — две стороны одной медали: обе подтверждают ваши исходные моральные убеждения. Неважно, либертарианская это утопия с невмешивающимся правительством, или адская антиутопия, в которой государство вторгается во всё, вы скажете: «Я всегда был прав.» Не стоит придумывать мир, который будет соответствовать вашим текущим идеалам государства, отношений, политики, работы или повседневной жизни. Не надо плыть ни по течению, ни против, создайте что-нибудь ещё. (Чтобы обезопасить свои идеалы, скажите себе: «Наверняка это хороший мир, но он не лучше моей любимой стандартной Утопии…». Однако, если ваши идеалы начнут меняться, вы поймёте, что всё сделали правильно.) (Building Weirdtopia.)

-

Если ваша Утопия оказалась мрачным местом, задыхающимся под тяжестью экзистенциальной тоски, и у вас ничего не получается с этим поделать, значит, есть как минимум одна серьёзная проблема, на которую вы совсем не обратили внимания. (Existential Angst Factory.)

-

Жалок тот разум, который заботится лишь о себе и ни о чём другом. В нашем мире, чтобы заметить множество людей, находящихся в отчаянном положении, альтруисту стоит лишь оглянуться. У людей в лучшем мире картина иная: в настоящей Эутопии не так легко найти жертв, которых нужно спасать. Из этого не следует, что жители Эутопии оглянувшись вокруг, ничего не увидят: они смогут заботиться о друзьях и семье, правде и свободе, совместных проектах, а также других разумах, общих целях и высоких идеалах. (Higher Purpose.)

-

В то же время, не стоит для своей истории об Эутопии использовать удобный сюжет «Тёмный Лорд Саурон собирается напасть и всех убить». Потенциальный автор обязан придумать какие-то чуть менее ужасные вызовы для своих персонажей. Ведь прогресс человечества не мешает рассказывать истории об отдельных людях, и люди могут интересно жить даже в отсутствие неминуемой угрозы смерти. Показать это — интересная и сложная задача. Тем же, кому интересны катастрофы планетарного масштаба, стоит сосредоточиться на наших современных реалиях. (Higher Purpose.)

Найти решение, которое удовлетворит всем вышеизложенным условиям, — упражнение для читателя. По крайней мере, пока.

Упоминание в данном списке определённых законов не должно быть истолковано как отрицание или принижение неупомянутых. Например, я не написал о юморе, но мир без смеха был бы тосклив, и т.д.

Каждому, кто всерьёз хочет написать Эутопию с применением этих законов, я хочу сказать: сначала научитесь писать. Существует очень много книг о том, как писать. Вам нужно прочесть минимум три. В любой из них будет упомянуто о важности практики. Тренироваться лучше на чём-нибудь полегче, чем Эутопия. Тем не менее, мой второй совет авторам таков: вашим персонажам никогда не будет скучно и просто, пока они могут создавать друг другу трудности.

И напоследок хочу предупредить: детальная проработка мира, который лучше, чем ваша жизнь, может высосать вашу душу как дементор. Теория Удовольствий опасна. Применяйте её осторожно, вас предупредили.

- 1. Каждый из пунктов этого эссе ссылается на какое-то эссе из упомянутой цепочки «Теория удовольствия». К сожалению, эта цепочка пока ещё не дождалась своих переводчиков на русский язык. — Прим.перев.

- 2. Цитируется по переводу Тимоти Феррис, «Как работать по четыре часа в неделю», ООО «Издательство «Добрая книга», 2008, 2010. — Прим.перев.

- 3. Здесь и далее Юдковский использует слово «Эутопия»(Eutopia) для обозначения «настоящей» Утопии, той, в которой действительно приятно жить. — Прим.перев.

Атеизм = не-теизм + анти-теизм

Время от времени нам задают вопросы из серии «Какая польза от того, чтобы постоянно быть недовольным по поводу того, что Бога нет?». С другой стороны, мы слышим такие фразы, как «Младенцы — атеисты от природы». Мне кажется, что такие замечания и довольно глупые дискуссии, которые вокруг них разгораются, показывают, что понятие «атеизм» на самом деле состоит из двух отдельных компонентов. Назовём их «не-теизм» и «анти-теизм».

Чистый «не-теист» — это человек, выросший в обществе, в котором понятие «Бог» просто никогда не было изобретено — письменность в этом обществе изобрели раньше сельского хозяйства, и одомашивание растений и животных было делом рук ранних учёных. В таком мире суеверие добралось только до первобытного этапа, на котором мир кажется наполненным множеством духов, почти не имеющих собственной морали. Затем суеверие вступило в конфликт с наукой и сошло на нет.

Суеверия первобытных охотников и собирателей не очень похожи на то, что мы обычно понимаем под «религией». Ранние западные комментаторы часто высмеивали их, утверждая, что они и вовсе религией не являются; эти комментаторы, на мой взгляд, были правы. У охотников и собирателей сверхъестественные агенты не имеют никакой особенной моральной грани, и не следят за соблюдением каких-то правил. Их можно умилостивить церемониями, но им не поклоняются. И, что самое главное, охотники и собиратели ещё не успели расщепить свою эпистемологию. У первобытных культур нет специальных правил для рассуждений о «сверхъестественных» сущностях, или даже явного разграничения между сверхъестественным и естественным; духи грома просто существуют в рамках естественного мира, о чём свидетельствует молния, и наш ритуальный танец вызова дождя призван управлять ими. Это, наверно, не идеальный танец вызова дождя, но это лучший из всех, что пока придумали — был ещё тот знаменитый случай, когда он сработал…

Если бы вы показали первобытным людям ритуал для вызова дождя, который работал бы со стопроцентной гарантией посредством взывания к другому духу (или завод по опреснению воды, что в принципе одно и то же), они, скорее всего, быстро избавились бы от старого. У них нет специальных правил для рассуждения (English) о духах — ничего, что могло бы оправдать результат теста имени пророка Илии, который прошёл новый ритуал и не прошёл старый. Для отрицания этого теста нужна вера, религиозные убеждения — а это концепция, возникшая уже после аграрного периода. Перед этим не было государств, в которых священнослужители были ветвью власти, боги не являлись моральным стандартом и не следили за соблюдением установленных вождями правил, и за сомнения в них и их существовании не было специального наказания.

И поэтому цивилизация не-теистов, изобретя науку, просто самым обычным образом делает вывод, что дождь, оказывается, вызван конденсацией в облаках, а не духами. Они ощущает некоторую неловкость по поводу старого суеверия и без промедления выбрасывают его прочь. Они не испытывают никаких трудностей, потому что у них есть лишь суеверия, они ещё не успели добраться до анти-эпистемологии (English) (дополнительных правил мышления в определённых категориях, обычно для защиты существующих убеждений от опровержения).

Не-теисты не знают, что они «атеисты», потому что им никто не рассказал, во что они должны не верить — никто не изобрел «высшего бога», который был бы главным в пантеоне, не говоря уже о монолатрии или монотеизме.

Тем не менее, не-теисты уже знают, что они не верят в существование духов деревьев. Мы можем даже предположить, что они не только не верят в лесных духов, но и в целом имеют хорошую, развитую эпистемологию, и поэтому понимают, что постулировать онтологически базовые ментальные сущности (сущности, которые нельзя редукционистски свести к не-ментальным сущностям, таким, как атомы) — не очень хорошая идея.

Как не-теисты встретят идею Бога?

— Вселенная была создана Богом.

— Кем?

— Э-э, гм, Богом. Бог есть Творец — разум, который решил создать вселенную, и…

— А, так вы утверждаете, что вселенная была создана разумным агентом. Похоже, вы говорите о стандартной гипотезе о том, что мы живём в компьютерной симуляции. Вы, кажется, весьма уверены в этом — у вас что, есть какие-то сильные свидетельства?..

— Нет, я не имею ввиду Матрицу! Бог — это не житель другой Вселенной, запустивший симулятор этой, он просто… Его невозможно описать. Он есть Первопричина, Творец всего, и…

— Кажется, вы постулируете онтологически базовую мыслящую сущность. К тому же, то, что вы предложили — это просто таинственный ответ на таинственный вопрос. Вообще, откуда вы всё это взяли? Не могли бы вы начать рассказ со своих свидетельств — какие новые наблюдения Вы пытаетесь объяснить?

— Мне не нужно никаких свидетельств, у меня есть Вера!

— У вас есть что?

И в этот самый момент не-теисты впервые стали атеистами. То, благодаря чему произошла эта трансформация и есть приобретение анти-теизма — формулирование явных аргументов против теизма. Если вы ни разу не слышали о Боге, вы можете быть не-теистом, но не анти-теистом.

Конечно же, не-теисты не собираются изобретать какие-то новые правила для опровержения Бога — они просто применяют стандартные эпистемологические принципы, которые были разработаны их цивилизацией в процессе отказа от других теорий и концепций — таких, скажем, как витализм. Рационалисты утверждают, что именно так и должен выглядеть анти-теизм в нашем мире: анализ религии при помощи стандартных, общих правил. Этот анализ, как становится ясно достаточно скоро, приводит к её полному отбрасыванию — как с точки зрения познания мира, так и с точки зрения морали. Каждый анти-теистический аргумент должен быть частным случаем общего правила эпистемологии или морали, применимого и вне религии — к примеру, в столкновении науки и витализма.

Если принять во внимание различие между не-теизмом и анти-теизмом, то многие современные споры становятся более понятными — например, вопрос «Зачем придавать столько значения тому, что Бога не существует?» можно перефразировать в «Какова польза обществу от попыток распространения анти-теизма?» Или вопрос «Какой толк от того, чтобы быть просто против чего-то? Где ваша позитивная программа?» превращается в «Меньше анти-теизма и больше не-теизма!». И становится понятно, почему фраза «дети рождаются атеистами» звучит странновато — просто дети не имеют понятия об анти-теизме.

Теперь что касается утверждения о том, что религия совместима с разумным познанием: найдётся ли хоть одно религиозное утверждение, которое не будет отвергнуто хорошо развитой, продвинутой цивилизацией не-теистов? Не будет отвергнуто в ситуации, когда ни у кого нет причин быть осторожным с выводами, нет специальных правил, выделяющих религию в отдельный магистерий, и нет последователей существующих традиционных религий, которых не хотелось бы расстраивать?

Борьба против богизма не имеет никакой самостоятельной ценности — общество не-теистов забудет об этом споре на следующий же день.